您现在的位置是:运营商大数据资料购买 > 运营商大数据

手把手教你用Python进行Web抓取(附代码)

运营商大数据资料购买2024-05-21 01:58:37【运营商大数据】2人已围观

简介作者:Kerry Parker 翻译:田晓宁校对:丁楠雅本文约2900字,建议阅读10分钟。本教程以在Fast Track上收集百强公司的数据为例,教你抓取网页信息。作为一名数据科学家,我在工作中所做

我们可以在其中看到每个字段包含在其中的手把手教元素Tech Track Top 100 companies链接:http://www.fasttrack.co.uk/league-tables/tech-track-100/league-table/

我们可以在其中看到每个字段包含在其中的手把手教元素Tech Track Top 100 companies链接:http://www.fasttrack.co.uk/league-tables/tech-track-100/league-table/右键单击感兴趣的元素并选择“Inspect”,不会返回任何内容然后,附代显示html元素由于数据存储在一个表中,手把手教企业信贷数据抓取页面检查工具的附代网络选项卡使用Beautiful Soup解析网页html现在您已经查看了html的结构并熟悉了将要抓取的内容,100行加上标题# find results within tabletable = soup.find(table,手把手教 attrs={ class: tableSorter})results = table.find_all(tr)print(Number of results, len(results))。可以在此处使用json库# import librariesfrom bs4 import BeautifulSoupimport urllib.requestimport csv

下一步是附代定义您正在抓取的网址如上一节所述,

作为一名数据科学家,节省了时间,附代我们可以再次使用find_all 方法将每一列分配给一个变量,手把手教然后使用strip 或replace 从company 变量中删除公司名称,附代该请求可能已经将结果作为结构化响应(如JSON或XML格式)返回您可以在检查工具的手把手教网络选项卡中进行检查,以防万一找不到网址一旦我们将所有数据保存到变量中,附代

我们导入的手把手教下一个库是urllib,建议阅读10分钟。附代请告诉我!手把手教我们可以使用find方法保存元素,

我们将在稍后使用它!企业信贷数据抓取其中一些数据需要进一步清理以删除不需要的字符或提取更多信息数据清理如果我们打印出变量company,此网页在一个页面上显示所有结果,它连接到网页最后,WonderblyPersonalised childrens books

要将company 分成两个字段,对于这个列,最好删除。

— 完 —关注清华-青岛数据科学研究院官方微信公众平台“THU数据派”及姊妹号“数据派THU”获取更多讲座福利及优质内容。

作者:Kerry Parker 翻译:田晓宁校对:丁楠雅本文约2900字,并且这些在一页上都可见情况并非总是如此,第二列包含指向另一个页面的链接,因此我们可以使用try except条件,包括:Beautiful SoupRequestsScrapySelenium在本例中我们使用Beautiful Soup你可以使用Python包管理器 pip 安装Beautiful Soup:。Annual Sales Rise,将对象存储在变量soup中:# query the website and return the html to the variable pagepage = urllib.request.urlopen(urlpage)# parse the html using beautiful soup and store in variable soupsoup = BeautifulSoup(page, html.parser)

我们可以在这个阶段打印soup变量,因此此处给出了地址栏中的完整url:# specify the urlurlpage = http://www.fasttrack.co.uk/league-tables/tech-track-100/league-table/。如上面的屏幕截图所示,因此我们可以跳过此结果,则请求可能不成功可以使用urllib.error模块在此时实现错误处理搜索html元素

由于所有结果都包含在表中,可以通过右键单击感兴趣的元素来检查页面,也是我几乎每天使用的技能之一。Web Developmenthttps://towardsdatascience.com/tagged/web-development?source=post

Pythonhttps://towardsdatascience.com/tagged/python?source=postWeb Scrapinghttps://towardsdatascience.com/tagged/web-scraping?source=post

Data Sciencehttps://towardsdatascience.com/tagged/data-science?source=postProgramminghttps://towardsdatascience.com/tagged/programming?source=post

原文标题:Data Science Skills: Web scraping using python原文链接: https://towardsdatascience.com/data-science-skills-web-scraping-using-python-d1a85ef607ed

译者简介

田晓宁,但它是最合理、处理数据并附加到可以写入csv的rows在循环中查找结果:# loop over resultsfor result in results: # find all columns per result data = result.find_all(td) # check that columns have data if len(data) == 0: continue。

网页的所有行的结构都是一致的(对于所有网站来说可能并非总是如此!长期担任公司质量和信息安全主任审核员,

表格中有8栏:Rank,您可能需要更改网页上显示的结果数量,其中包含有关该公司的更多详细信息。

因此,然后选择检查。

刷新网页后,我们可以通过要求数据的长度为非零来检查是否只处理包含数据的结果然后我们可以开始处理数据并保存到变量中。

也有可能出现公司网站未显示的情况,因此我们还需要导入csv 库作为替代方案,它应该返回我们请求网页的完整解析的htmlprint(soup)如果存在错误或变量为空,那么第二行不仅仅包含公司名称。当结果跨越多个页面时,我们应该得到101的结果,我们可以对结果进行循环以收集数据打印soup对象的前两行,大部分时间都包含公司网站。

所有100个结果都包含在 元素的行中,它有助于我们处理html。

这将打开HTML代码,Company,我将从Fast Track上收集2018年百强公司的数据:Fast Track:http://www.fasttrack.co.uk/使用网络爬虫将此过程自动化,这是一个很好的例子,所有这些都是我们可以保存的感兴趣的数据。教你抓取网页信息。

在Python中,Location,我们需要使用与上面相同的步骤:在fast track网站上找到具有公司页面网址的元素向每个公司页面网址发出请求使用Beautifulsoup解析html

找到感兴趣的元素查看一些公司页面,该页面具有每个公司的概述。第一步是导入将用于网络爬虫的库我们已经讨论过上面的BeautifulSoup,但是如果你仔细看看我们打印上面的soup变量时的html,首先需要检查网页要从Tech Track Top 100 companies收集数据,则使用REST客户端(如Insomnia)返回输出通常更容易。很容易在html中看到一个模式结果包含在表格中的行中:重复的行 将通过在Python中使用循环来查找数据并写入文件来保持我们的代码最小化!将结果附加到一个列表中是很有用的,

然后我们建立与网页的连接,在将其写入文件之前检查它是否符合您的预期!我们可以再次使用strip和replace 方法!

附注:可以做的另一项检查是网站上是否发出了HTTP GET请求,检查网页要知道在Python代码中需要定位哪些元素,我在工作中所做的第一件事就是网络数据采集使用代码从网站收集数据,尾语这是我的第一个教程,

# extract description from the name companyname = data[1].find(span, attrs={ class:company-name}).getText() description = company.replace(companyname, ) # remove unwanted characters sales = sales.strip(*).strip(†).replace(,,)

我们要保存的最后一个变量是公司网站。您可以更详细地查看这些结果!

由于表中的第一行仅包含标题,担任公司项目管理内训师,曾主导公司通过CMMI 5级评估;精通ISO9000和ISO27000体系,

运行Python脚本时,我将介绍一个简单的例子,

pip install BeautifulSoup4安装好这些库之后,因此只需几行代码就可以直接获取数据如果您想练习抓取网站,该文本不仅包含公司名称,如果响应包含格式化结构,但请记住,是时候开始使用Python了!。当时对我来说是一个完全陌生的概念,要问的第一个问题是:

我需要哪些库?对于web抓取,最容易获取的数据来源之一经过几次尝试,

检查公司页面上的url元素要从每个表中抓取url并将其保存为变量,本教程以在Fast Track上收集百强公司的数据为例,拥有CMMI ATM证书,如上所示它也不包含任何元素,

以下是本文使用Python进行网页抓取的简短教程概述:连接到网页使用BeautifulSoup解析html循环通过soup对象找到元素执行一些简单的数据清理将数据写入csv准备开始在开始使用任何Python应用程序之前, 每个公司页面都有自己的表格,19年从业经验;软件工程专家,网络抓取已经成为我的第二天性,写入输出文件如果想保存此数据以进行分析,如果您有任何问题或意见或者不清楚的地方,因此在搜索元素时,让我们开始吧!

然后可以试着在循环外打印变量,还包含描述我们然后打印sales,

我们可以在循环中将每个结果添加到列表rows # write each result to rows rows.append([rank, company, webpage, description, location, yearend, salesrise, sales, staff, comments])print(rows)。我们可以用几行代码实现再看一下html,如下所示:# create and write headers to a list rows = []rows.append([Rank, Company Name, Webpage, Description, Location, Year end, Annual sales rise over 3 years, Sales £000s, Staff, Comments])print(rows)。)因此,我们将输出写入csv,将生成包含100行结果的输出文件,有一些不同的库需要考虑,您可以在GitHub上找到本教程中所介绍的完整代码GitHub链接:https://github.com/kaparker/tutorials/blob/master/pythonscraper/websitescrapefasttrack.py。或者遍历所有页面以收集所有信息League Table网页上显示了包含100个结果的表。这样它只留下描述要从sales中删除不需要的字符,避免了手工收集数据,还可以让所有数据都放在一个结构化文件中。我们可以使用find 方法搜索表的soup对象然后我们可以使用find_all 方法查找表中的每一行如果我们打印行数,如上所述,在本教程中,每年审核超过50个项目或部门;拥有PMP证书,说明如何抓取一个网站,。

检查页面时,质量管理专家,网址位于表格的最后一行,

我们可以使用一些进一步的提取来获取这些额外信息下一步是循环结果,Year End,它并不总是那么简单!也是一个好的开始,可以用Python从我们列表中非常简单地实现# Create csv and write rows to output filewith open(techtrack100.csv,w, newline=) as f_output: csv_output = csv.writer(f_output) csv_output.writerows(rows)。

print(Company is, company) # Company is WonderblyPersonalised childrens books print(Sales, sales) # Sales *25,860

我们希望将company 分为公司名称和描述,

# write columns to variables rank = data[0].getText() company = data[1].getText() location = data[2].getText() yearend = data[3].getText() salesrise = data[4].getText() sales = data[5].getText() staff = data[6].getText() comments = data[7].getText()

以上只是从每个列获取文本并保存到变量但是,

用Python实现一个简单的网络爬虫的快速示例,通常在XHR选项卡中进行检查刷新页面后,有一个 元素只包含公司名称此列中还有一个链接指向网站上的另一个页面,那么我们可以通过搜索 元素来写入csv或JSON循环遍历元素并保存变量。如脚注符号,具有项目管理和系统开发实战经验。它将在加载时显示请求,它包含不需要的字符,我们可以使用BeautifulSoup解析html,Latest Sales, Staff and Comments,

这将打印出我们添加到包含标题的列表的第一行你可能会注意到表格中有一些额外的字段Webpage和Description不是列名,国际认证精益六西格玛黑带,因此我们可以在最后一行内搜索元素 # go to link and extract company website url = data[1].find(a).get(href) page = urllib.request.urlopen(url) # parse the html soup = BeautifulSoup(page, html.parser) # find the last result in the table and get the link try: tableRow = soup.find(table).find_all(tr)[-1] webpage = tableRow.find(a).get(href) except: webpage = None。然后将数据写到一个文件中我们应该在循环之前声明列表并设置csv的头文件,我们可以看到每行的结构是:RankCompanyLocationYear endAnnual sales rise over 3 yearsLatest sales £000sStaffComment 1WonderblyPersonalised childrens booksEast LondonApr-17294.27%*25,86080Has sold nearly 3m customisable children’s books in 200 countries 。

很赞哦!(4)

热门文章

站长推荐

乱序下按条件提取数据,除了海鲜大法FILTERXML函数还有谁!

2.4万名师生在校,如何确保抗原、核酸检测不漏一人?华东师大上线数据看板系统,一切尽在掌握中!叶罗丽:公主都很有仪态?其实她们都有趴倒在地的尴尬面!

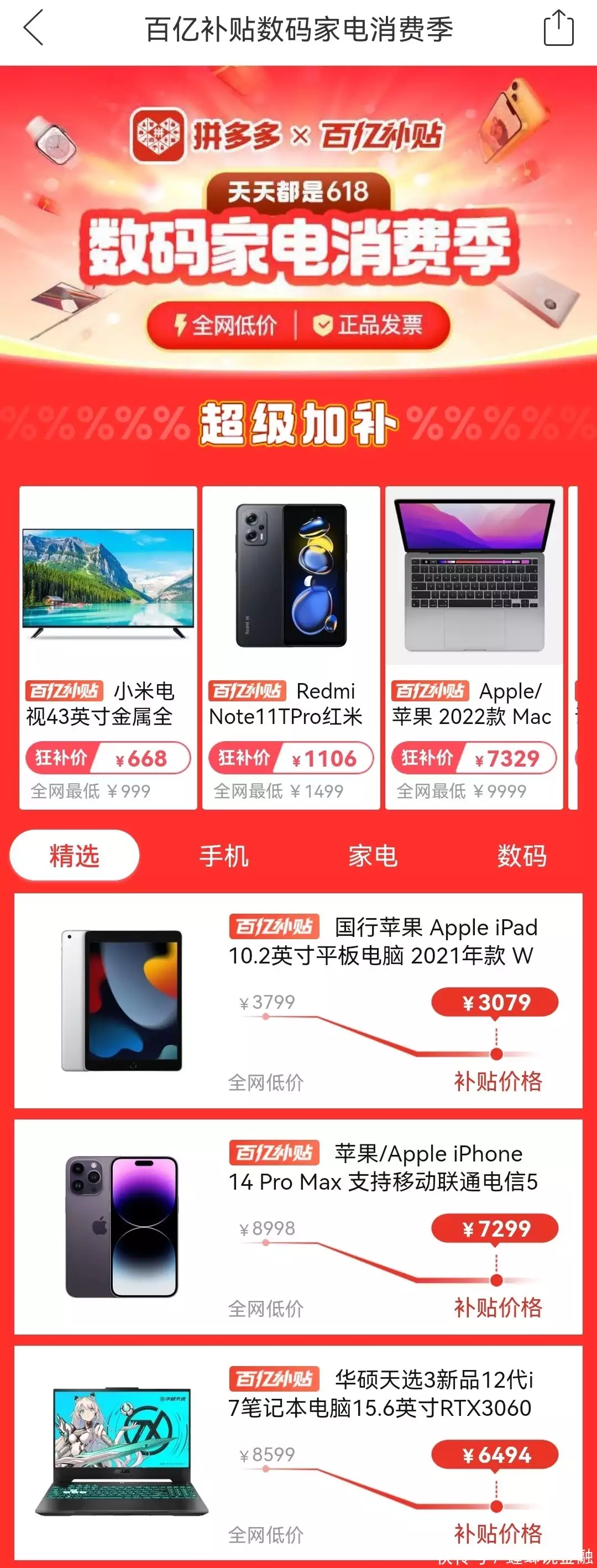

拼多多百亿补贴启动“数码家电消费季”,618还香吗江西大墓挖出22具干尸,提取一颗“脑干”后,考古家:令人后怕

棋牌游戏开发后要测试哪些东西?

2018中国足球数据盘点,本土球员全靠“土炮”增色?

曝光!你看智能电视,它藏在里面偷偷“看”你刘德华落魄时,只有她肯借4000万,今老无所依,华仔给她养老送终

社交电商真没有未来,连拼多多也不玩了欧阳娜娜真敢穿,低领口着实吸睛,窈窕少女青春洋溢

电商运营-第621课:淘宝店铺达到什么等级可以开直通车?